Après le déploiement de Commvault AI Protect, les environnements cloud peuvent désormais disposer d’une fonction “undo” pour les agents d’IA.

Ces logiciels autonomes peuvent parcourir l’infrastructure et, selon leurs actions, supprimer des fichiers, interroger des bases de données, lancer des clusters de serveurs ou encore modifier des droits d’accès. Commvault a donc identifié un risque de gouvernance et propose AI Protect : un système qui repère, surveille et annule les opérations menées par des modèles autonomes dans AWS, Microsoft Azure et Google Cloud.

La gouvernance classique repose sur des règles fixes : on attribue des permissions à un utilisateur humain, qui exécute ensuite une tâche plutôt prévisible. Avec les agents, le comportement peut émerger. Face à un prompt complexe, ils enchaînent parfois des actions autorisées mais combinées de manière non prévue. Dans le pire des cas, une “optimisation” peut mener à la suppression d’une base de données de production en quelques millisecondes.

Quand un humain ralentit avant une commande destructive, l’agent, lui, poursuit son raisonnement interne. Il peut envoyer des milliers d’appels API par seconde, bien plus vite que la capacité de réaction des équipes sécurité.

Pranay Ahlawat (Chief Technology and AI Officer chez Commvault) explique : « Dans des environnements agentiques, les agents modifient l’état des données, des systèmes et des configurations, souvent rapidement et difficilement traçable. En cas de problème, il faut pouvoir revenir non seulement aux données, mais à l’ensemble du “stack” : applications, configurations des agents et dépendances. »

Des outils de gouvernance adaptés aux agents cloud

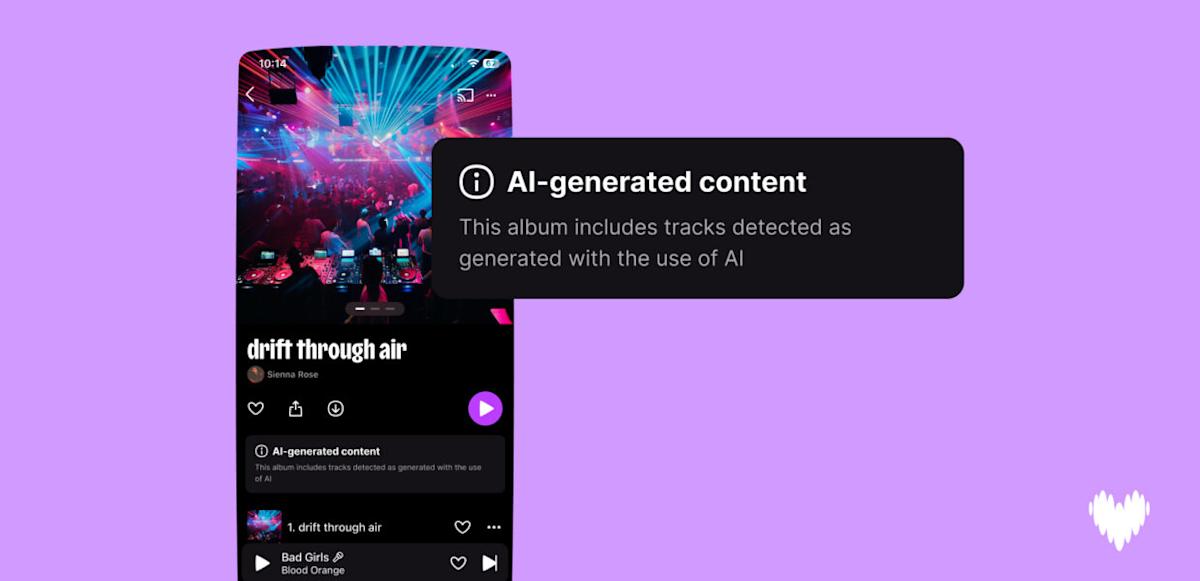

AI Protect s’appuie sur une surveillance continue pour détecter les agents actifs dans le cloud. L’objectif est de limiter le “shadow AI”, c’est‑à‑dire des agents expérimentaux mis en place sans alerter les équipes IT ou sécurité, parfois avec des accès internes à des données.

Une fois l’agent identifié, la solution observe ses appels API et ses interactions avec les données sur AWS, Azure et GCP, en enregistrant notamment les lectures de bases, les modifications de stockage et les changements de configuration.

La restauration “rollback” joue alors le rôle de filet de sécurité : si un modèle se trompe ou interprète mal une commande, les administrateurs peuvent ramener l’environnement à l’état exact qui existait avant le début de l’action.

Comme les infrastructures cloud sont fortement interconnectées, revenir en arrière exige une traçabilité précise. Il ne s’agit pas seulement de restaurer une table : l’agent peut aussi avoir modifié le réseau, déclenché des fonctions en aval et ajusté des politiques d’accès. Commvault combine donc l’architecture de sauvegarde avec une surveillance continue.

En cartographiant l’impact de la session de l’agent, la solution isole les changements dus à l’IA de ceux réalisés par des équipes humaines sur la même période, évitant ainsi un rollback global qui toucherait à des opérations légitimes.

À mesure que les machines agissent plus vite que les équipes humaines ne peuvent surveiller, la priorité devient de garantir que chaque action autonome puisse être annulée rapidement et fidèlement.