L’industrialisation de la découverte de vulnérabilités par l’intelligence artificielle pourrait inverser un équilibre qui, jusqu’ici, jouait plutôt en faveur des attaquants. En réduisant le coût et le temps nécessaires pour identifier des failles, ces approches tendent à rapprocher la cybersécurité du modèle « détection et correction » plutôt que de la réaction tardive.

Jusqu’à présent, la doctrine dominante consistait à rendre l’exploitation coûteuse : l’attaquant devait mobiliser des moyens importants pour parvenir à ses fins. Cette logique repose sur un facteur clé : l’écart entre la capacité des équipes de défense et celle des acteurs malveillants à découvrir rapidement des failles exploitables.

Des correctifs en masse qui remettent le statu quo en question

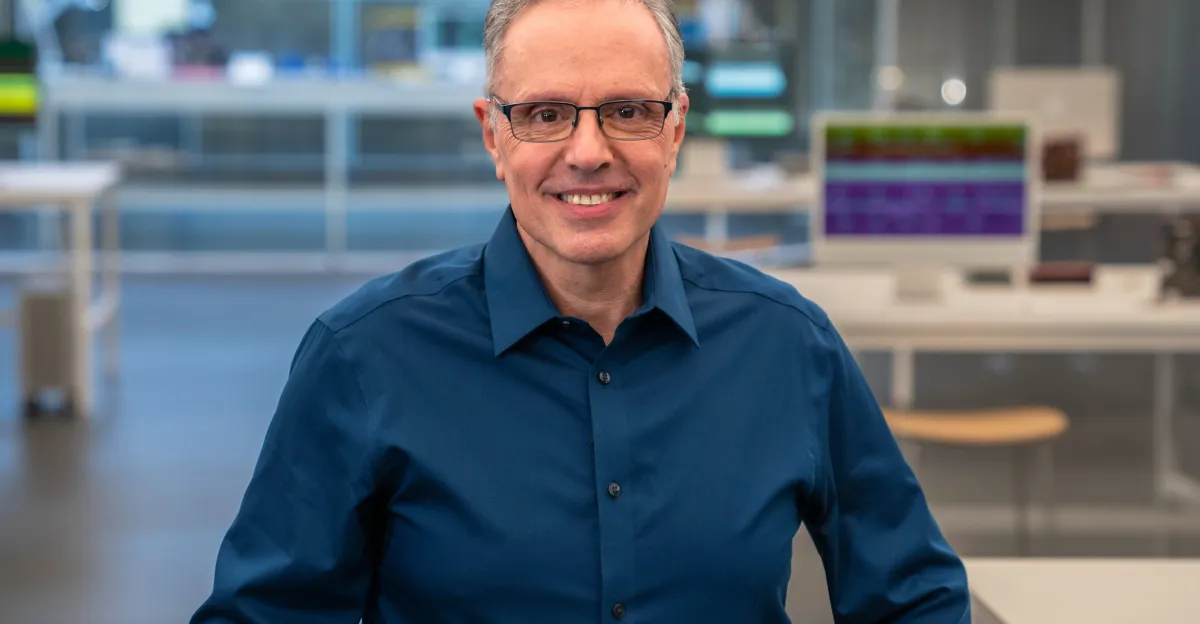

Une évaluation menée par l’équipe d’ingénierie de Firefox, en s’appuyant sur un modèle d’IA de type Claude (Mythos Preview), suggère que l’IA peut accélérer et élargir la découverte de vulnérabilités. Lors d’une première campagne de test, des centaines de failles ont été repérées et corrigées pour une version planifiée, puis d’autres correctifs sont venus s’ajouter à la suite d’une collaboration précédente.

Le point saillant n’est pas seulement le volume de résultats, mais la capacité à intégrer ces découvertes dans un processus de correction déjà existant. À grande échelle, la difficulté est autant organisationnelle que technique : prioriser, vérifier, puis appliquer des correctifs sans déstabiliser l’ensemble.

Pourquoi l’IA peut réduire les coûts côté entreprise

Dans un contexte réglementaire plus strict et sous la pression du risque opérationnel (fuite de données, ransomware, interruption de service), la prévention devient économiquement prioritaire. Les tests automatisés peuvent contribuer à réduire les dépenses liées aux audits ponctuels, souvent réalisés par des consultants externes.

En pratique, l’approche vise à automatiser une partie du travail de recherche sur le code : des scans répétés et contextualisés aident à repérer des zones suspectes plus tôt dans le cycle de développement.

Les limites à maîtriser : calcul, intégration et faux positifs

Reste un enjeu majeur : l’intégration d’un modèle IA avancé dans les pipelines d’intégration continue (CI). Traiter de grandes bases de code peut exiger des ressources de calcul importantes et une architecture qui conserve la séparation stricte des données propriétaires.

Un autre défi concerne la qualité des sorties. Les modèles peuvent produire des alertes inexactes. Pour limiter l’impact, les équipes doivent souvent croiser les résultats avec d’autres outils d’analyse statique, ainsi qu’avec les résultats d’essais de robustesse (par exemple via des techniques de fuzzing) menés en interne.

Vers une réduction de l’écart de découverte entre défense et attaque

Un avantage traditionnel des attaquants tient à leur capacité à concentrer des efforts humains sur la découverte d’une faille spécifique, parfois au détriment de la couverture globale. Si l’IA réduit le coût unitaire de détection, l’écart de découverte se resserre, et la défense peut traiter davantage de problèmes avant qu’ils ne deviennent exploitables.

Par ailleurs, l’argument central n’est pas que l’IA invente des menaces totalement nouvelles, mais qu’elle accélère la mise au jour de problèmes existants. Pour des logiciels conçus avec une modularité permettant l’analyse humaine, les défauts restent, en théorie, dans des ensembles identifiables et corrigibles.

Quelles implications pour les stratégies de sécurité des organisations

À court terme, l’arrivée d’un grand volume de résultats impose un effort de tri et de remédiation. Les équipes sécurité et ingénierie doivent adapter leurs priorités, renforcer leurs validations et traiter les corrections sans créer de dette technique.

À plus long terme, la tendance pourrait modifier les attentes en matière de diligence raisonnable : si des méthodes automatisées permettent une couverture plus rapide, ne pas les utiliser pourrait être perçu comme un risque managérial.

Repères matériels : sécuriser l’environnement d’analyse

Au-delà des modèles, la qualité de l’environnement d’analyse compte. Pour des tests automatisés et des traitements de données sensibles, beaucoup d’organisations s’appuient sur des infrastructures adaptées, capables de gérer à la fois la performance et la sécurité. À titre indicatif, une configuration réseau et une segmentation matérielle peuvent être soutenues par des équipements comme un pare-feu/routeur professionnel, par exemple un routeur pare-feu de niveau entreprise, utile pour encadrer l’accès et limiter les surfaces exposées.

Côté observabilité et opérations, disposer d’une capacité de collecte de logs et de supervision fiable aide à relier les résultats des analyses à des signaux de risque concrets. Un appliance ou solution de gestion de journaux peut contribuer à consolider les événements et à suivre l’efficacité des remédiations.