Les modèles d’intelligence artificielle s’appuient de plus en plus sur des données actualisées en continu pour comprendre le comportement des marchés. Dans les cryptomonnaies, où les cours et volumes évoluent sans interruption, la donnée n’est plus un simple point de comparaison : elle ressemble davantage à un flux. L’enjeu n’est donc pas seulement d’analyser des tendances, mais de suivre des signaux qui changent en permanence, et d’en tirer des interprétations suffisamment fiables pour éclairer la lecture du marché.

Un flux de données plutôt qu’un jeu figé

Dans de nombreux domaines, les données sont collectées, nettoyées puis réutilisées sur une période déterminée. À l’inverse, dans la finance et particulièrement dans les cryptomonnaies, les entrées arrivent sans pause. Les systèmes doivent alors traiter l’information au fil de l’eau, en intégrant les variations au moment où elles se produisent. Un prix comme celui du BNB n’est plus seulement une valeur isolée : il devient un élément d’un flux, porteur d’un contexte dynamique.

Cette approche est utile lorsque l’objectif consiste à repérer des changements plutôt que de s’en remettre à des hypothèses stables. Dans certains cas, de faibles déplacements peuvent suffire à faire évoluer une lecture du marché. En pratique, la difficulté tient souvent moins à la disponibilité de la donnée qu’à sa capacité à être traitée avec rapidité, notamment quand plusieurs sources doivent être combinées.

Des signaux difficiles à interpréter dans un marché non linéaire

Les comportements de marché ne suivent pas toujours des trajectoires régulières. Les variations de prix peuvent être irrégulières, et les liens entre causes et effets se brouillent. Dans cet environnement, un modèle ne se contente pas d’identifier un signal unique : il doit comprendre comment plusieurs indicateurs interagissent, même lorsque leurs relations se modifient.

Par ailleurs, certains acteurs de marché peuvent amplifier des mouvements sans qu’ils conduisent forcément à une stabilisation rapide. Résultat : l’interprétation à court terme peut devenir plus instable, car les patterns observés peuvent ne pas se répéter de manière strictement identique d’une période à l’autre.

Le poids des données et les biais potentiels

La façon dont la donnée est distribuée influence aussi le comportement des modèles. Tous les actifs ne génèrent pas la même fréquence d’informations, ni la même densité d’observations. Cette réalité se retrouve dans la construction des jeux de données et, par conséquent, dans la manière dont certains signaux dominent le modèle.

À titre d’illustration, la place du Bitcoin dans l’ensemble du marché tend à être élevée, tandis que les altcoins plus éloignés du sommet de la hiérarchie peuvent contribuer de façon plus limitée. Cela n’exclut pas leur prise en compte, mais leurs signaux peuvent être moins constants, ce qui complique leur utilisation dans des systèmes qui exigent des mises à jour régulières. Sans traitement spécifique, le modèle peut reproduire un biais : il apprend principalement à partir de ce qui apparaît le plus souvent dans les données.

Des exigences croissantes en matière d’infrastructure et de cohérence

À mesure que ces systèmes se généralisent, l’infrastructure devient un facteur clé. L’enjeu n’est pas seulement de collecter des flux, mais de garantir leur cohérence sur la durée : qualité des données, continuité, stabilité des pipelines de traitement et capacité à produire des résultats compréhensibles.

Dans un contexte où des acteurs institutionnels renforcent leur présence, les attentes se déplacent vers des standards plus stricts en matière de conformité, de gouvernance et de gestion des risques. Concrètement, cela signifie que des systèmes qui fonctionnent en continu doivent être robustes et que leurs outputs doivent pouvoir être expliqués, au-delà de la seule performance du modèle.

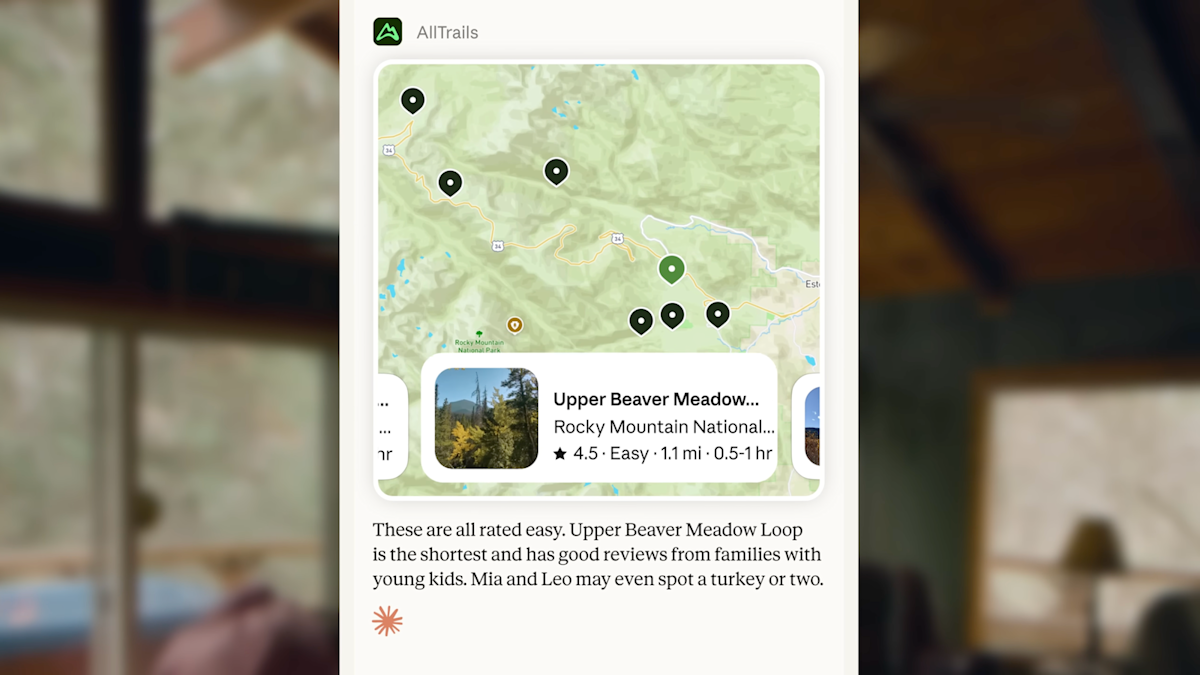

Des interprétations qui se rapprochent d’usages concrets

Les données de marché en temps réel ne servent pas uniquement à produire des analyses ponctuelles. Elles alimentent de plus en plus des systèmes fonctionnant en continu : surveillance, détection de changements, ou identification de ruptures de régime. Dans de nombreux cas, l’IA reste surtout un outil d’interprétation, située entre la donnée brute et une décision opérationnelle.

Cette dynamique se reflète aussi dans l’augmentation de certaines formes d’activité liées aux usages numériques (par exemple, les volumes associés à des cartes de paiement crypto), même si leur taille reste encore modeste par rapport aux paiements traditionnels. À mesure que ces passerelles entre l’écosystème crypto et des usages plus “réels” se développent, la donnée en temps réel peut devenir un élément plus directement connecté à l’activité observée.

En définitive, le temps réel n’apporte pas une compréhension automatique du marché. Il fournit une matière première plus vivante, et le rôle de l’IA consiste à en extraire une lecture cohérente malgré l’instabilité des comportements. À mesure que les modèles évoluent, la manière d’exploiter ces flux, par exemple autour de la valeur d’un terminal orienté données de trading, peut également s’affiner pour mieux répondre à la variabilité du marché.