Le monde contemporain est traversé par des divergences culturelles, des fractures politiques et des tensions géopolitiques. Dans ce contexte, les investisseurs en capital-risque doivent identifier des entreprises capables de grandir suffisamment pour générer des rendements à l’échelle du secteur. C’est dans cette logique que s’inscrit Kompas VC, qui déploie une stratégie attentive aux réalités régionales.

Basé à Amsterdam, Copenhague, Berlin et Tel Aviv, le fonds a annoncé un nouveau véhicule d’investissement de 160 millions d’euros pour soutenir ses prises de participation. L’objectif : mieux naviguer dans un environnement de plus en plus fragmenté, tout en conservant une ligne claire autour de la compétitivité industrielle.

Une stratégie construite autour de trois pôles économiques

Kompas VC part d’une lecture du monde en trois sphères d’activité économique et politique : les États-Unis, l’Europe et la Chine. Selon le partenaire du fonds, les trajectoires y diffèrent, ce qui impose d’adapter les attentes et la manière d’évaluer le potentiel de croissance des startups.

Le fonds a historiquement privilégié des entreprises qui répondent à des défis clés de compétitivité industrielle : fabrication, chaînes d’approvisionnement, infrastructures critiques ou encore durabilité. Si ces thèmes demeurent, leur importance relative varie selon les régions.

Des priorités qui évoluent avec le cycle technologique

Kompas VC a également reconnu le changement de paradigme depuis la création du fonds. Là où, autour de 2021, l’enthousiasme était fort pour des sujets industriels et de durabilité, le paysage actuel est davantage structuré par l’intelligence artificielle et des dynamiques de croissance plus rapides. Le fonds indique toutefois rester centré sur des enjeux qui relèvent directement du monde physique, et non uniquement sur des usages numériques.

Dans cette optique, il cible des startups liées à la décarbonation, à l’amélioration de la productivité et à la gestion des risques. Le fonds affirme avoir trouvé une niche, tout en la décrivant comme suffisamment large pour couvrir plusieurs secteurs.

Investir tôt, avec des tickets adaptés

Avec son deuxième fonds, Kompas VC prévoit de disposer de marges pour mener des tours de table à un stade précoce. Les montants envisagés se situent entre 3 et 5 millions d’euros par investissement, selon la structure des opérations.

L’approche s’appuie sur des relations locales en Europe, où le fonds bénéficie d’un accès à un large éventail de fondateurs et d’entreprises. Mais la stratégie doit aussi tenir compte des limites que peut introduire la fragmentation mondiale sur la capacité de certaines startups à atteindre une taille critique.

Les effets culturels et réglementaires sur l’expansion

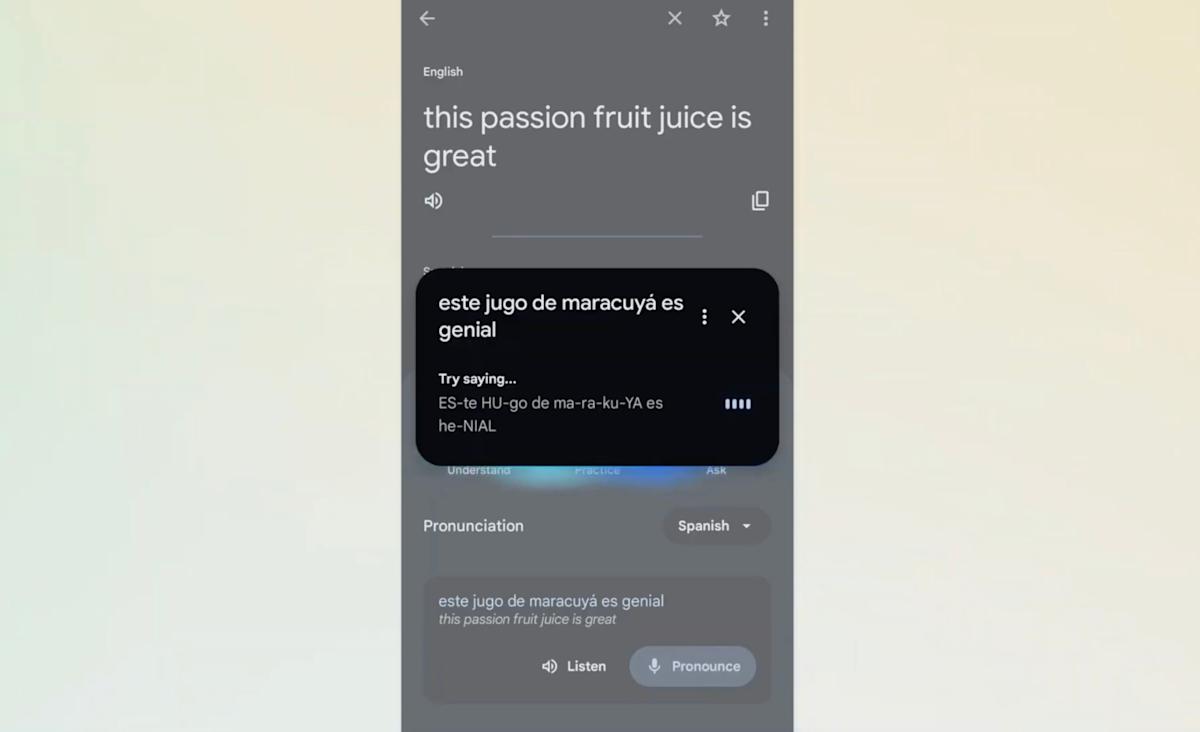

Le fonds souligne que la fragmentation ne concerne pas seulement les marchés, mais aussi les habitudes industrielles et les cadres culturels. L’exemple cité concerne le logement préfabriqué : déjà largement utilisé dans certains pays scandinaves, ce modèle serait moins répandu ailleurs en Europe, et encore plus rare aux États-Unis.

L’argument avancé est que l’enjeu n’est pas uniquement technologique. Il tiendrait aussi à la manière dont les acteurs d’un secteur évaluent et adoptent des solutions. Dans ce cadre, la question devient celle de la taille du marché adressable lorsque le produit n’entre pas naturellement dans les pratiques dominantes d’une région.

La même logique s’observe sur des thématiques comme la durabilité : elle demeure très attractive en Europe, mais paraît moins “porteuse” aux États-Unis qu’elle ne l’a été par le passé. Pour un fonds focalisé sur des sujets industriels, l’écart d’alignement entre régions peut influencer le rythme d’adoption et la trajectoire de croissance.

Des horizons longs pour absorber les retournements

Kompas VC investit sur des horizons de 10 à 15 ans, ce qui permet de traverser plusieurs cycles réglementaires. Le fonds estime que, malgré les incertitudes, les changements de politiques et de priorités peuvent créer des opportunités, mais aussi provoquer des bascules parfois rapides et imprévues.

Dans ce contexte, Kompas considère que sa taille relative peut constituer un avantage : être capable de jouer un rôle de premier investisseur sur des thèmes spécifiques, puis d’entrer plus tôt dans des trajectoires portées par certains fondateurs, avant que l’attention du marché ne se généralise.

Deux pistes pour suivre des thématiques proches

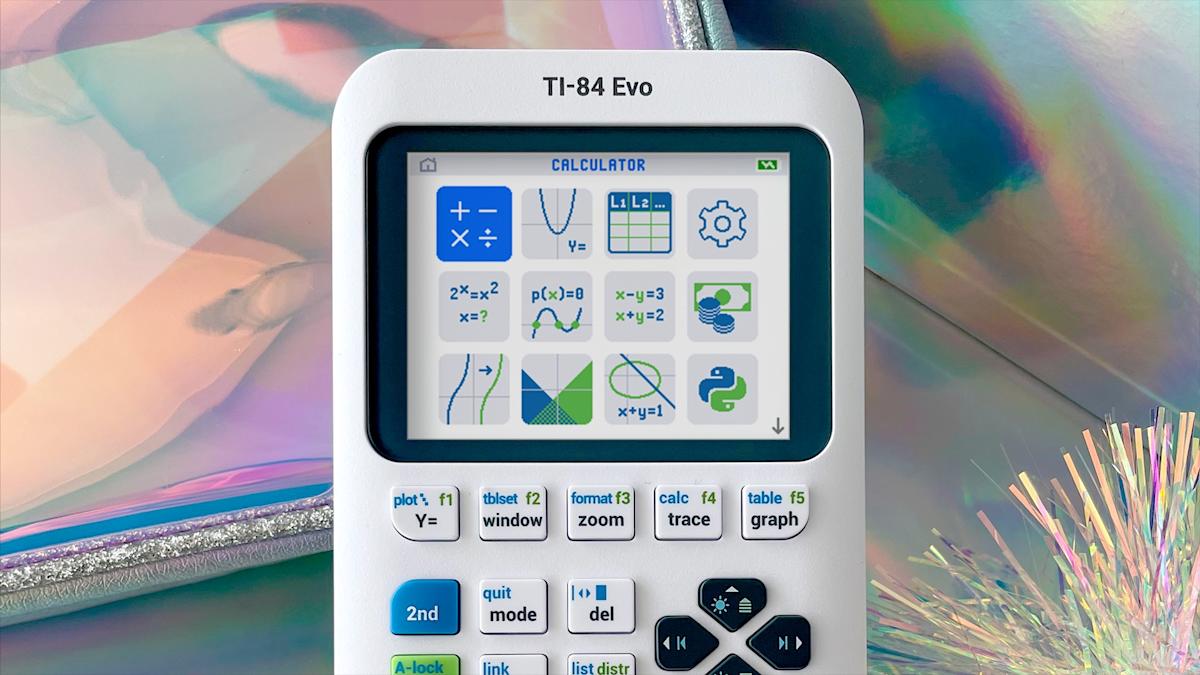

Pour mieux comprendre les besoins industriels autour de la transition énergétique et de la production bas-carbone, certains entrepreneurs et ingénieurs s’appuient aussi sur des équipements et des matériels de mesure. Par exemple, des outils de capteurs de qualité de l’air peuvent aider à évaluer et piloter des stratégies de décarbonation dans l’industrie, même si leur utilisation dépend fortement des cas d’usage.

Côté efficacité opérationnelle, l’essor des solutions visant à améliorer la productivité passe souvent par l’automatisation et le suivi des données en atelier. Un capteur de suivi de consommation énergétique pour applications industrielles illustre par exemple comment des données plus fines peuvent soutenir des projets d’optimisation et de réduction des émissions.