La cotation d’une entreprise sur le point de franchir le seuil des 10 milliards de dollars de valorisation ne passe jamais inaperçue. Dans le cas de Lightelligence, les investisseurs semblent avoir déjà intégré une réponse à une question que ses résultats financiers n’apportent pas encore clairement : pourquoi l’interconnexion optique devient-elle un sujet stratégique pour l’IA ?

Alors que la société affiche des revenus en forte croissance mais aussi des pertes nettement plus rapides, la dynamique boursière suggère que le marché parie sur une rupture technologique appelée à limiter les goulots d’étranglement actuels entre puces de calcul.

Pourquoi l’interconnexion optique intéresse l’IA

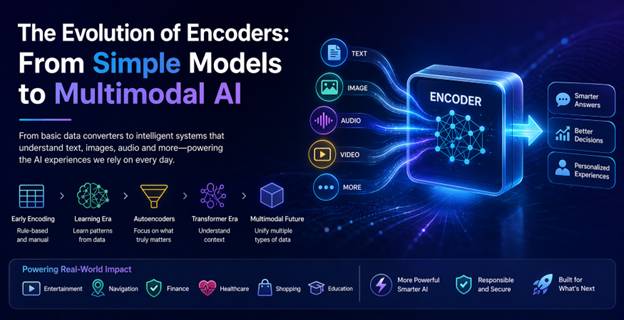

Les grands modèles d’IA reposent sur des clusters de processeurs fonctionnant en parallèle. La performance globale dépend fortement de la capacité à échanger des données entre ces puces : plus le transfert est rapide et efficace, plus l’exécution est optimisée.

Or, dans les architectures actuelles, ces échanges passent majoritairement par des liaisons électriques en cuivre. À mesure que les systèmes s’agrandissent et consomment davantage, ces liaisons atteignent leurs limites : elles génèrent de la chaleur, demandent une énergie importante et plafonnent sur la bande passante sur de courtes distances.

L’interconnexion optique consiste à remplacer ces signaux électriques par des signaux lumineux. À la manière d’un passage d’une route à une autoroute, l’objectif est d’augmenter la capacité, de réduire la latence et d’améliorer l’efficacité énergétique.

Ce que fait Lightelligence : interconnexion et calcul optique

Lightelligence se positionne sur deux axes complémentaires. D’une part, l’interconnexion optique vise à relier des unités de calcul au sein d’un serveur ou sur plusieurs serveurs dans un cluster. D’autre part, l’entreprise développe aussi des solutions de calcul optique, où certaines opérations seraient réalisées à l’aide de photons plutôt que d’électrons.

Son produit le plus mis en avant, LightSphere X, est présenté comme une solution de commutation optique distribuée adaptée aux interconnexions de GPU à l’échelle des super-nœuds. L’entreprise affirme que cette approche peut améliorer l’utilisation des performances de calcul (FLOPS) et réduire le coût total de possession des charges de travail liées à l’IA.

Un marché où l’exécution compte autant que la technologie

Dans ce secteur, l’écart entre recherche et déploiement industriel reste un point clé. Les acteurs qui parviennent à passer au stade commercial peuvent attirer l’attention des clients hyperscalers et des intégrateurs de datacenters.

Lightelligence met en avant une capacité à atteindre, selon certaines analyses, un déploiement à grande échelle sur un segment où beaucoup d’initiatives demeurent encore expérimentales. La société revendique aussi un portefeuille de brevets substantiel couvrant plusieurs aspects de ses deux activités.

En parallèle, le paysage concurrentiel reste dominé par de grands groupes, avec une place importante pour les fournisseurs nationaux. Lightelligence apparaît comme un acteur majeur parmi les fournisseurs indépendants, tout en faisant face à des positions dominantes sur le marché global.

Des comptes encore fragiles, mais un pari sur l’adoption

Les chiffres financiers rendent l’histoire plus nuancée. Les revenus progressent rapidement d’une année à l’autre, mais l’entreprise enregistre aussi des pertes qui se creusent, ce qui est souvent le cas des sociétés technologiques en phase d’industrialisation.

Son endettement relatif et sa concentration client constituent également des points à surveiller : lorsqu’un segment dépend fortement de quelques acheteurs, la trajectoire commerciale peut fluctuer. De plus, la vitesse de croissance des pertes par rapport aux revenus traduit la difficulté à atteindre l’équilibre au rythme attendu.

Cependant, le marché semble valoriser plus que des revenus actuels. L’entreprise bénéficie notamment d’un capital scientifique et d’une histoire de recherche associée à l’optique appliquée à l’apprentissage profond, un socle qui soutient la crédibilité de sa feuille de route.

À ce stade, la valorisation élevée au moment de l’introduction en bourse peut s’interpréter comme un “pari” : celui de voir l’interconnexion optique franchir plus vite les prochaines étapes d’adoption, au-delà des prototypes, et devenir un élément central des architectures d’IA de nouvelle génération.

Ce que l’observateur doit suivre après la cotation

-

La capacité à convertir la croissance commerciale en amélioration progressive de la rentabilité.

-

La diversification de la base clients afin de réduire le risque lié à la concentration.

-

Le passage à l’échelle : volumes, intégration dans des clusters GPU, et répétabilité des déploiements chez des clients clés.

Repères utiles pour comprendre l’écosystème

Pour saisir l’enjeu, il est utile de garder en tête que la majorité des datacenters s’appuie sur des systèmes d’interconnexion sophistiqués où chaque gain de latence, de bande passante ou d’efficacité peut se traduire par des économies d’exploitation. Dans cette logique, des solutions de rack et de gestion thermique peuvent devenir déterminantes pour accompagner des architectures plus exigeantes. Par exemple, un capteur pour serveur avec température et humidité permet d’objectiver le suivi des conditions opérationnelles dans des environnements denses.

De la même façon, la compréhension des contraintes réseau et de l’alimentation est centrale lorsqu’on compare des architectures électriques et optiques. Un compteur de puissance réseau pour datacenter aide à relier consommation et performance, même si ce type d’outil ne mesure pas directement l’optique, il met en perspective l’arbitrage énergétique.