Les questions de puissance de calcul, de sécurité et d’usages concrets de l’intelligence artificielle se retrouvent au cœur de l’actualité. Entre la course aux investissements, les débats réglementaires et les tensions autour de la fiabilité des systèmes, le secteur avance vite — et pas toujours de manière coordonnée. En parallèle, certains signaux moins visibles, comme l’évolution des projets de data centers ou les limites rencontrées par des technologies autonomes, dessinent une trajectoire plus complexe qu’il n’y paraît.

La course aux moyens : l’IA continue de creuser l’écart

Les grands acteurs de la tech enregistrent de nouveaux records d’investissements dans l’intelligence artificielle. La progression est particulièrement marquée pour ceux qui consolident leurs infrastructures et accèdent à l’énergie et aux capacités de calcul nécessaires. Plusieurs entreprises mettent en avant des retours économiques liés à ces efforts, tandis que d’autres font face à des inquiétudes persistantes chez les investisseurs, notamment lorsque les plans annoncés semblent moins clairs ou plus risqués.

Ce contexte relance aussi le débat sur la nature même du « cycle » autour de l’IA : les dépenses massives peuvent soutenir des gains mesurables, mais elles alimentent également des attentes qui, si elles ne se concrétisent pas au même rythme, peuvent accentuer la volatilité.

Régulation et cybersécurité : l’accès aux modèles devient un enjeu politique

Aux États-Unis, des discussions autour de l’accès à certains modèles d’IA soulignent un point de friction majeur : comment concilier l’innovation et la diffusion des outils avec les risques de cybersécurité. Les inquiétudes portent sur la possibilité que des modèles trop largement accessibles puissent être détournés, et sur la capacité des administrations à conserver un contrôle suffisant sur les ressources nécessaires (notamment le « compute »).

Dans le même temps, la valorisation de certains acteurs renforce les tensions : plus le marché chiffre haut, plus la pression augmente sur la gouvernance, la transparence et la conformité.

Conflits autour de la gouvernance : propriété, but non lucratif et avenir des modèles

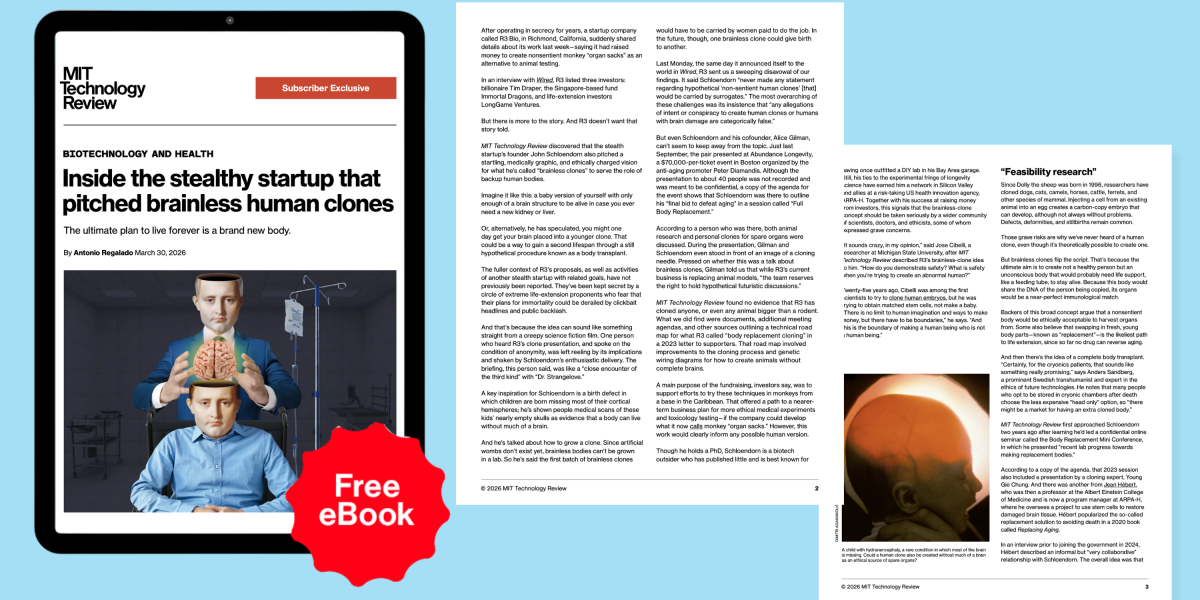

Une autre ligne de fracture concerne la structure et la gouvernance de certaines organisations liées à l’IA. Des accusations publiques visant des dirigeants d’outils majeurs ravivent un débat de fond : qui contrôle réellement la trajectoire technologique, et comment s’articulent les objectifs d’intérêt public avec des ressources et des intérêts privés.

Au-delà du volet juridique, l’enjeu est stratégique : les batailles de gouvernance peuvent redessiner les priorités de recherche, les modalités de financement et, in fine, l’accès aux technologies.

Automatisation : quand la fiabilité devient un problème opérationnel

Les véhicules autonomes, souvent présentés comme une technologie en progression continue, font face à des retours terrain plus nuancés. Des signalements d’anomalies et de difficultés accrues dans certaines situations laissent penser que l’automatisation peut se heurter à des conditions réelles plus exigeantes que les environnements de test.

Cette réalité renforce l’idée que la performance d’un système ne se limite pas à sa capacité à « fonctionner » : elle dépend aussi de sa robustesse, de la gestion des incidents et de la capacité à s’améliorer au rythme des contraintes du monde réel.

Infrastructures : certains plans IA se reconfigurent

Les projets de déploiement d’infrastructures à grande échelle ne suivent pas toujours la trajectoire initialement annoncée. Des ajustements sont évoqués, notamment lorsque les besoins de calcul semblent plus lourds que prévu, ou lorsqu’un modèle économique moins favorable impose de revoir le format des investissements.

Autrement dit, l’IA n’est pas uniquement une question d’algorithmes : elle dépend aussi d’une industrie de support, coûteuse et soumise à des arbitrages permanents.

Éthique et responsabilité : plaintes, usages sensibles et fiabilité

Les controverses autour de l’utilisation de systèmes conversationnels se déplacent progressivement vers la responsabilité. Des actions en justice mettent en cause la qualité et la sécurité de certaines versions de chatbots, en particulier lorsqu’ils peuvent être exploités dans des contextes graves.

Sur le plan plus technique, des études rappellent un risque fréquent : les réponses formulées avec un ton « bienveillant » ou empathique peuvent parfois contenir davantage d’erreurs. Cela met en évidence une tension entre la convivialité du langage et la rigueur factuelle.

Industrie et produits : le rythme des lancements ralentit

Dans l’univers matériel, certains produits semblent marquer le pas. Des signaux indiquent que des engagements autour de dispositifs de réalité augmentée ou virtuelle pourraient être revus à la baisse, après des résultats commerciaux jugés décevants. Cette dynamique reflète un marché plus exigeant, où le succès dépend autant de l’usage réel que de la promesse technologique.

Données humanoïdes : cap sur de nouveaux standards (et nouveaux risques)

À mesure que les capacités des modèles progressent, l’attention se déplace aussi vers des cas d’usage liés aux « données humanoïdes » : systèmes capables d’interpréter des gestes, des mouvements, des postures et, plus largement, des informations cinématiques proches de l’humain. L’ambition est claire : accélérer la création de robots et d’agents physiques, ou au moins rendre les simulations plus réalistes.

Le défi est double. D’une part, la collecte et la structuration de données de qualité demandent des infrastructures dédiées et des protocoles stricts. D’autre part, ces données peuvent poser des questions de confidentialité et de consentement, surtout lorsqu’elles s’appuient sur des capteurs ou sur des séquences capturant des caractéristiques corporelles potentiellement sensibles. Dans ce domaine, la gouvernance de la donnée devient aussi déterminante que le modèle lui-même.

Au fond, la « future » de l’Arctique ou d’autres environnements extrêmes passe aussi par ces capacités : mieux comprendre et simuler des comportements proches de l’humain aide à concevoir des systèmes plus autonomes, capables de travailler dans des conditions difficiles. Mais cette progression implique une exigence accrue en matière de sécurité et de validation, afin d’éviter que des performances perçues en laboratoire se dégradent sur le terrain.

Ce qu’il faut retenir

- La puissance de calcul et les infrastructures restent le facteur central de l’IA.

- La régulation s’intensifie, surtout pour l’accès aux modèles sensibles.

- Les conflits de gouvernance peuvent influencer durablement les trajectoires technologiques.

- La fiabilité, dans le monde réel comme dans le contenu généré, demeure un sujet critique.

Pour suivre l’évolution des enjeux liés à la conception durable et aux infrastructures, certains lecteurs peuvent aussi s’intéresser aux solutions qui optimisent la consommation énergétique des bâtiments, un sujet transversal pour les data centers. Par exemple, des guides sur les maisons passives et l’efficacité énergétique permettent de mieux comprendre comment réduire la demande en énergie grâce à l’isolation, l’étanchéité et la ventilation — des principes utiles quand on pense à l’empreinte énergétique des systèmes numériques. De même, des kits ou guides pour configurer un environnement de test type “homelab” peuvent aider à expérimenter des modèles ou des flux de données de façon contrôlée, tout en gardant une logique de vérification et de maîtrise des risques.