En Californie, les véhicules autonomes ne sont pas autorisés à transporter des mineurs non accompagnés. Chez Waymo, la politique est encore plus stricte : la société limite les trajets seuls pour les personnes de moins de 18 ans à la zone métropolitaine de Phoenix, en Arizona. Malgré ces règles, certains parents utiliseraient leurs propres comptes pour faire voyager leurs enfants en conduite autonome, notamment vers l’école, des activités ou des sorties. Waymo indique désormais vouloir mettre fin à cette pratique, en renforçant la détection des cas en infraction.

Un contrôle d’âge plus fréquent pendant les trajets

Waymo a confirmé travailler à une application plus stricte de ses conditions d’utilisation, après que des utilisateurs ont commencé à évoquer sur les réseaux sociaux l’apparition de vérifications d’âge en cours de trajet. La société explique disposer de « politiques en place » pour repérer les violations et indique continuer d’améliorer ses systèmes afin d’en accroître la précision.

En cas de non-respect des conditions, Waymo prévient que des sanctions peuvent aller jusqu’à la suspension temporaire ou définitive des comptes.

Caméras à bord et traitement des images

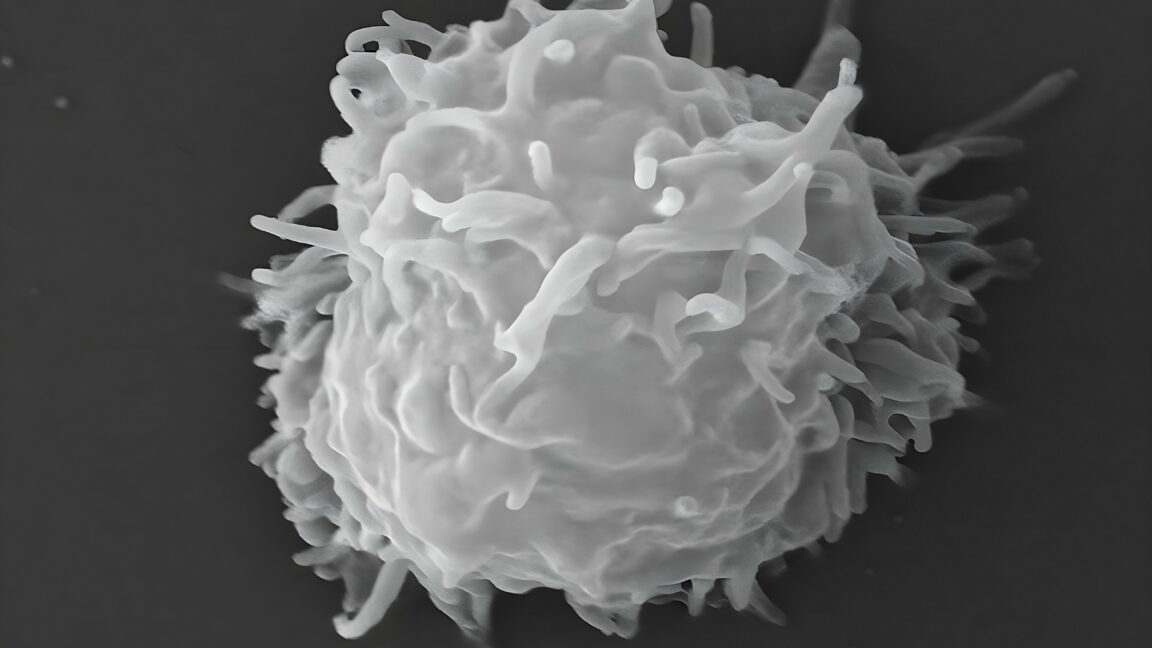

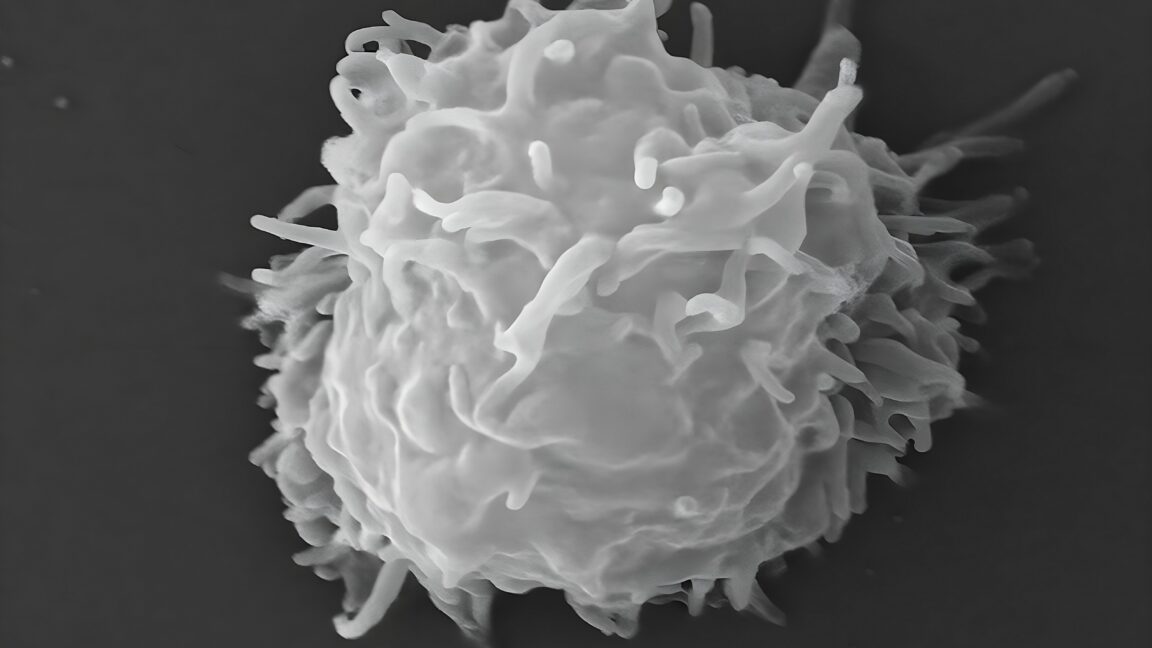

Pour vérifier le respect de ses règles, Waymo s’appuie sur des caméras installées à l’intérieur de ses véhicules. Sa politique de confidentialité indique que la société enregistre de la vidéo pendant les trajets.

Waymo précise également que des équipes d’assistance peuvent être amenées à examiner des séquences vidéo dans certaines circonstances. Dans les situations jugées plus urgentes, la société affirme pouvoir accéder à une vidéo en direct durant le trajet. En revanche, elle indique ne pas utiliser de reconnaissance faciale ni d’autres technologies biométriques pour identifier les personnes.

Contexte réglementaire en Californie

Cette décision intervient alors que des tensions existent déjà autour de l’utilisation des services autonomes pour le transport de mineurs. Un mois plus tôt, plusieurs organisations californiennes liées aux travailleurs, dont un syndicat de travailleurs « gig », ont déposé une plainte auprès d’une agence de régulation de l’État. Elles reprochent à Waymo de ne pas respecter les conditions liées à son autorisation d’exploitation, notamment en transportant des mineurs non accompagnés.

Parallèlement, la Californie évalue des règles susceptibles d’autoriser, à certaines conditions, des mineurs de moins de 18 ans à voyager seuls dans des voitures autonomes. Le cadre pourrait s’inspirer de dispositifs existants pour des services de transport avec chauffeur humain.

Des contrôles qui touchent aussi des adultes

Dans plusieurs cas rapportés, des vérifications d’âge déclenchées par le système ont concerné des passagers adultes. Certains utilisateurs indiquent avoir reçu un appel ou une demande de validation pendant le trajet, parfois pour des raisons liées à leur apparence ou aux circonstances (par exemple des indices visuels pouvant conduire le système à une estimation erronée de l’âge).

Waymo précise que ses équipes traitent les situations signalées, notamment dans les zones où des comptes « pour adolescents » sont autorisés.

Comptes adolescents : une exception circonscrite

Dans la zone de Phoenix, Waymo a mis en place des comptes permettant aux adolescents âgés de 14 à 17 ans d’effectuer des trajets seuls, avec un accompagnement de la part des adultes titulaires du compte, notamment via un suivi de localisation en temps réel. La société indique que des équipes spécialisées gèrent les incidents éventuels.

Dans les autres marchés américains, la règle générale autorise les adultes à être accompagnés de mineurs, avec des conditions supplémentaires pour les plus jeunes (notamment l’exigence de dispositif de retenue adapté).

Ce que cette évolution change pour les familles

En pratique, le renforcement du contrôle vise à réduire les contournements des politiques actuelles, en particulier en Californie. Il s’agit autant d’une question de conformité réglementaire que de cohérence interne des règles de service. Pour les familles, cela signifie que les trajets de mineurs non accompagnés via des comptes « adultes » pourraient devenir plus risqués, non seulement en termes de sanctions sur les comptes, mais aussi en raison d’éventuelles interruptions pendant le trajet.

Pour une gestion plus sereine des trajets, certains foyers privilégient désormais des solutions de suivi et d’encadrement à distance. À ce titre, un localisateur GPS pour enfants peut être utilisé comme complément organisationnel, même si cela ne remplace pas les règles du service de transport.

Enfin, comme les vérifications peuvent survenir en temps réel, disposer d’un accès rapide à un téléphone et à une application de communication peut faciliter la coordination lors d’un échange avec le support. Un chargeur portable peut aider à éviter les interruptions liées à l’autonomie.