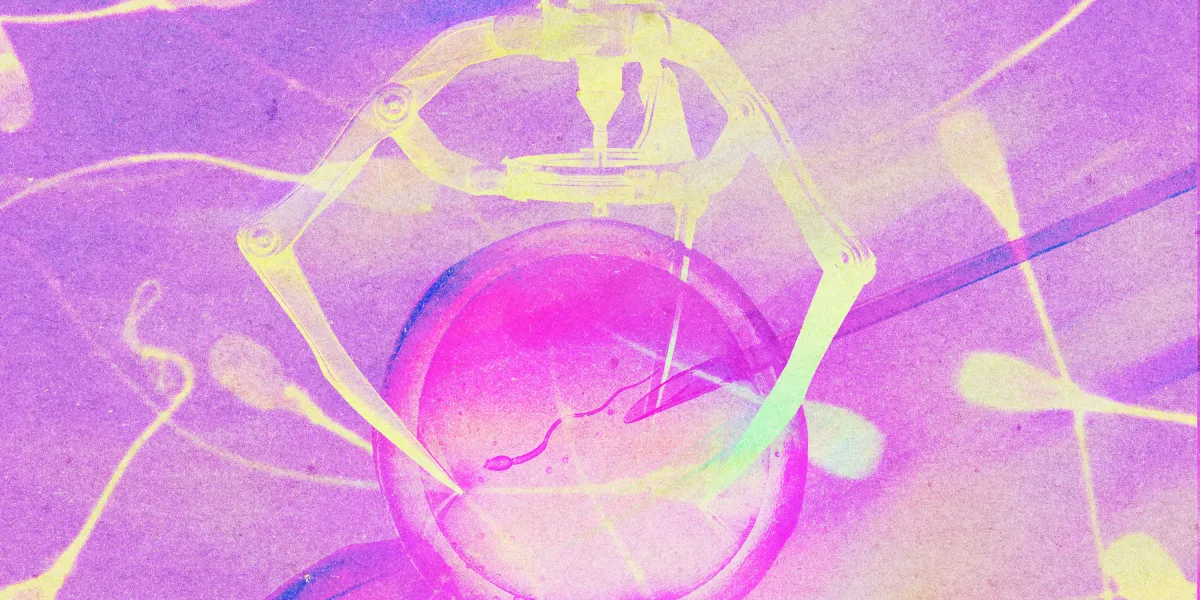

Les progrès récents en génétique et en automatisation transforment l’insémination in vitro (FIV/IVF). Mais l’enthousiasme technologique se heurte encore à des limites scientifiques, notamment lorsqu’il s’agit de prédire des caractéristiques complexes ou de garantir des résultats fiables pour chaque patient. Entre tests embryonnaires améliorés, débats éthiques et montée en puissance de l’intelligence artificielle, l’avenir de la FIV s’écrit désormais autant sur le terrain des preuves que sur celui des innovations.

Un levier majeur concerne les tests génétiques réalisés sur des embryons, rendus possibles par l’amélioration conjointe des techniques de biologie moléculaire et des méthodes de conservation. Les laboratoires peuvent aujourd’hui maintenir les embryons en culture plusieurs jours, congeler l’embryon le temps d’effectuer les analyses, puis le décongeler une fois les résultats obtenus.

Les tests de type PGT-A, souvent associés à la recherche d’anomalies chromosomiques, sont devenus très fréquents dans certaines cliniques. Toutefois, plusieurs spécialistes soulignent que ces analyses ne donnent pas une lecture parfaite du futur développement d’un enfant. Des anomalies détectées peuvent parfois ne pas empêcher une évolution vers une grossesse menant à un enfant en bonne santé, ce qui complexifie l’interprétation des résultats.

Des tests plus ambitieux, mais très controversés

Au-delà du dépistage d’irrégularités chromosomiques, d’autres tests se veulent plus prédictifs. Les tests dits PGT-P cherchent à estimer la probabilité que l’embryon développe des caractéristiques dites complexes, influencées par de nombreux gènes et par l’environnement. Ils pourraient couvrir des aspects médicaux, mais aussi des traits comme la taille, des facteurs cognitifs ou encore la sensibilité à certaines maladies.

Ces démarches sont jugées problématiques dans certains pays, tandis qu’elles progressent dans d’autres. En pratique, la principale difficulté réside dans le niveau de certitude : les caractéristiques complexes dépendent d’une multitude de facteurs et les liens entre variations génétiques et résultats individuels restent difficiles à traduire de façon robuste et directe. Des cliniciens indiquent aussi que sélectionner un critère peut introduire, par effet indirect, de nouveaux risques.

À ce jour, l’usage le plus largement accepté des tests génétiques demeure la prévention de maladies graves, là où les preuves sont les plus solides. Le débat reste ouvert sur la mesure dans laquelle des tests conçus pour prédire des traits non médicaux peuvent être considérés comme suffisamment fiables pour guider des décisions cliniques.

Accélérer et affiner avec l’intelligence artificielle

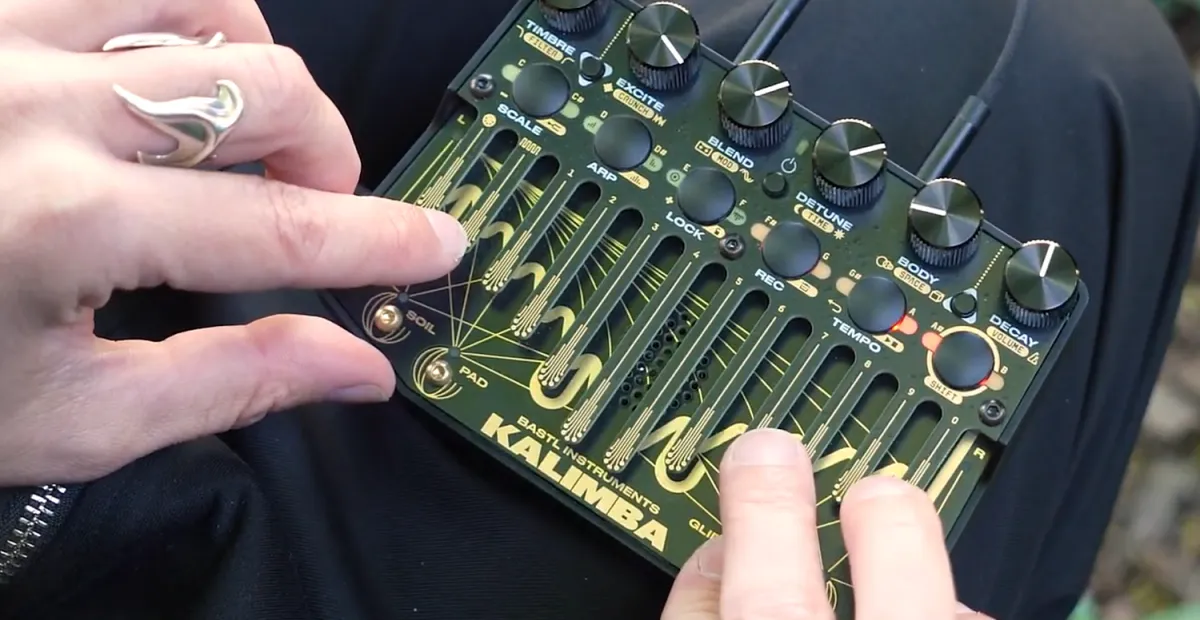

Parallèlement, l’intelligence artificielle suscite davantage d’optimisme, car elle excelle dans l’identification de schémas à partir d’images. Plusieurs équipes travaillent à améliorer la sélection et l’évaluation des gamètes et des embryons, avec l’objectif de rendre le processus plus précis et moins dépendant de la seule expertise humaine.

Un exemple se distingue : un système fondé sur l’IA a été conçu pour analyser de très nombreuses images issues d’échantillons de sperme où le nombre de spermatozoïdes fonctionnels est faible. Là où un biologiste pourrait avoir du mal à repérer un individu sain parmi des quantités limitées, la technologie peut inspecter et trier rapidement à grande échelle, et a déjà été associée à des résultats cliniques.

Plus largement, certaines équipes ont développé des outils capables de classer embryons, ovocytes ou spermatozoïdes, en s’appuyant sur des modèles entraînés. L’idée sous-jacente est de standardiser et d’optimiser des décisions qui, historiquement, reposaient sur des critères visuels parfois variables selon les conditions et les opérateurs.

La robotisation pour standardiser les étapes de la FIV

Une autre direction consiste à combiner ces outils avec des systèmes robotiques. L’objectif est de réaliser, autant que possible, les différentes étapes du cycle de FIV sous un même protocole : préparation et sélection des ovocytes et du sperme, fécondation, culture des embryons, puis choix de l’embryon destiné au transfert. En théorie, une telle automatisation pourrait réduire certaines sources de variabilité et limiter les effets liés à la fatigue ou aux différences de gestes.

Dans ce schéma, l’IA ne sert pas seulement à analyser : elle pourrait aussi piloter des décisions au sein d’une chaîne opératoire plus cohérente. Reste toutefois à vérifier, sur le long terme, l’impact réel de ces systèmes sur les taux de succès, la sécurité et la reproductibilité des résultats selon les contextes cliniques.

Ce qui paraît le plus probable à court terme

Les trajectoires les plus consistantes semblent converger vers des outils qui améliorent l’évaluation (images assistées par IA, standardisation des procédures) plutôt que vers des prédictions trop ambitieuses de traits complexes. Les tests génétiques de dépistage ont déjà trouvé leur place dans certains parcours, mais les applications à grande échelle pour des caractéristiques non directement liées à une maladie nécessitent encore une validation rigoureuse.

Dans l’écosystème des dispositifs et des systèmes de laboratoire, l’intérêt pour une meilleure acquisition et analyse d’images biologiques reste déterminant. Pour illustrer l’approche centrée sur la visualisation et le traitement, certains professionnels s’appuient aussi sur des solutions de capture d’images et de microscopie numériques, comme un adaptateur pour caméra de microscope permettant de numériser les observations et de faciliter l’exploitation par des logiciels. De même, pour les équipes qui travaillent sur des workflows informatiques, un SSD haute capacité pour poste de travail peut contribuer à réduire les délais de traitement et de stockage des données issues des analyses.