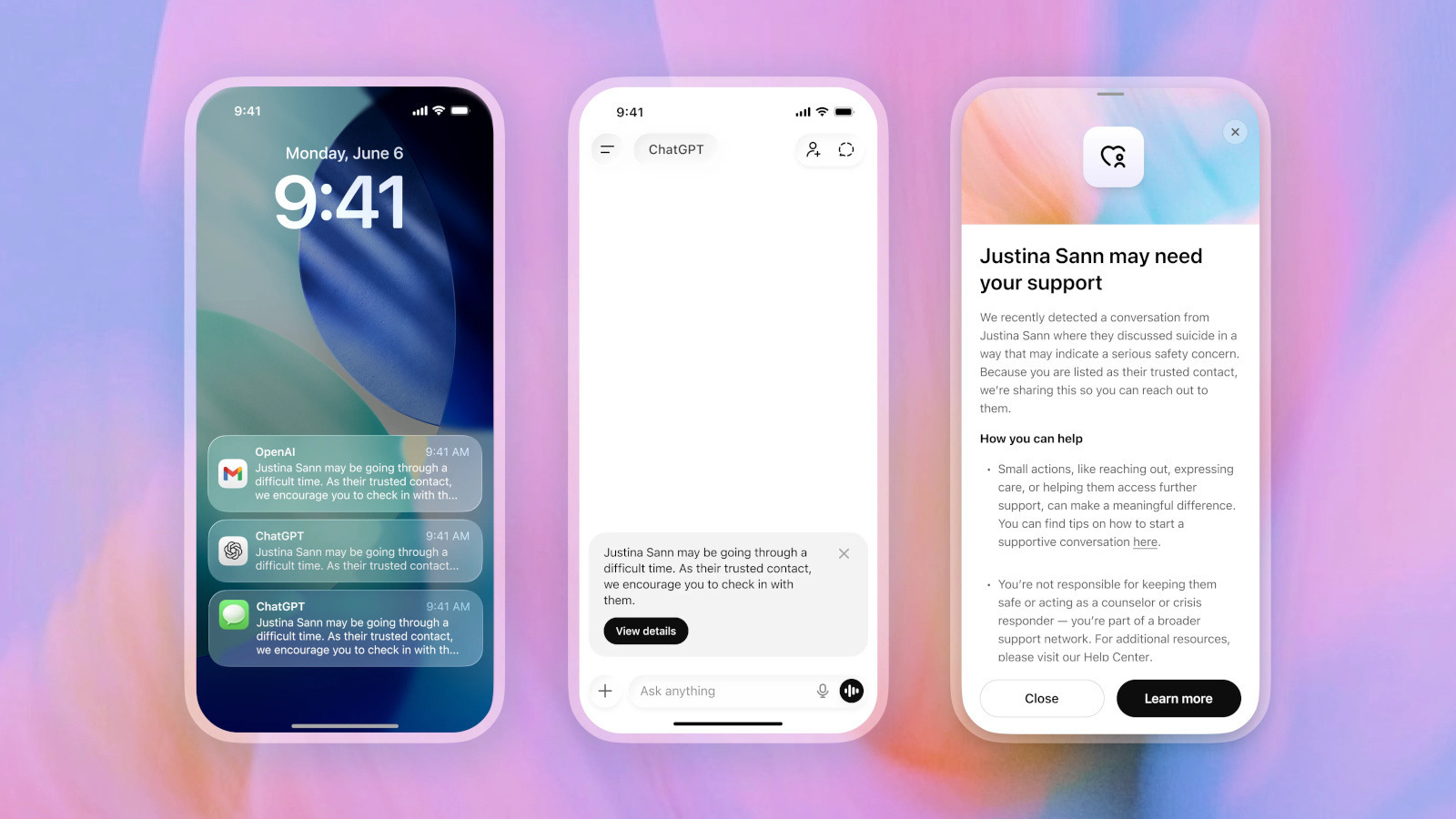

OpenAI annonce une nouvelle fonctionnalité pour ChatGPT, baptisée Trusted Contact, destinée à renforcer la prise en charge des situations où un utilisateur pourrait se mettre en danger. L’idée est simple : permettre à la personne concernée de désigner un proche adulte qui pourrait être contacté si l’outil estime qu’un risque de passage à l’acte est sérieux.

Une option pour prévenir lorsqu’un risque est détecté

Trusted Contact s’appuie sur des mécanismes déjà présents dans ChatGPT, mais ajoute une dimension de “relais” vers une personne de confiance. Concrètement, les utilisateurs âgés de 18 ans et plus peuvent choisir, dans les réglages, un adulte qui pourra être alerté en cas de risque de self-harm (automutilation) ou de danger imminent.

Le contact désigné reçoit alors une invitation à accepter, avec un délai d’une semaine. Sans réponse, l’utilisateur peut sélectionner un autre contact.

Un avertissement, puis une intervention encadrée

Lorsque le système détecte une situation potentiellement grave, ChatGPT commence par avertir l’utilisateur. Il l’encourage à contacter la personne désignée et peut proposer des idées de messages pour faciliter la prise de contact.

Le dispositif ne se limite toutefois pas à une automatisation totale. OpenAI indique qu’une équipe restreinte de personnes formées examine le cas. Ce n’est qu’en cas de risque jugé sérieux de passage à l’acte que l’entreprise procéderait à l’envoi d’un message au contact (par e-mail, notification dans l’application ou SMS).

Transparence pour le contact, sans divulgation des échanges

Dans les notifications envoyées, le contact est informé que ChatGPT a détecté une conversation évoquant des pensées suicidaires ou un risque lié à l’auto-préjudice. En revanche, pour des raisons de confidentialité, OpenAI précise que les transcriptions des échanges ne seront pas transmises.

OpenAI affirme aussi que les vérifications humaines sont effectuées avant l’envoi et que le traitement visé se fait rapidement, avec un objectif de revue en moins d’une heure.

Un contexte marqué par des controverses

Cette annonce intervient dans un contexte plus large de critiques autour de l’usage de l’IA en matière de santé mentale. OpenAI a déjà indiqué que de nombreux utilisateurs expriment des idées suicidaires dans leurs conversations. L’entreprise a également fait face à des contentieux, notamment une procédure évoquant un cas où ChatGPT aurait participé à des décisions menant au suicide d’un adolescent ; OpenAI a déclaré avoir amélioré ses réponses aux personnes en détresse depuis ces événements.

Prudence et limites : l’outil ne remplace pas les professionnels

Même si Trusted Contact vise à ajouter une couche de sécurité, la mesure reste encadrée : elle ne constitue pas un substitut aux soins, ni à l’intervention de services spécialisés. Dans les situations de crise, les contacts d’urgence et les lignes d’écoute restent prioritaires.

Pour le grand public, il peut aussi être utile de se doter d’outils pratiques pour rester joignable, par exemple une station de charge portable fiable afin de ne pas manquer un appel ou une notification en cas d’urgence.

Enfin, un moyen simple de structurer l’accès aux numéros d’aide consiste à préparer à l’avance une liste dans un espace sécurisé, par exemple via un coffre ou organisateur de documents permettant d’avoir rapidement les informations essentielles.

En cas de pensées suicidaires ou de risque immédiat pour soi-même ou autrui, il est recommandé de contacter les services d’urgence ou une ligne d’écoute spécialisée disponible 24/7.